Quando è l’Intelligenza artificiale a scrivere l’articolo

Davvero stiamo già leggendo testi non redatti da esseri umani? Sareste in grado di riconoscere un contenuto prodotto artificialmente? Quali conseguenze può avere tutto ciò nel di

Davvero stiamo già leggendo testi non redatti da esseri umani? Sareste in grado di riconoscere un contenuto prodotto artificialmente? Quali conseguenze può avere tutto ciò nel dibattito pubblico e quali i rischi per la società? Per fugare ogni dubbio, Varesefocus ha “intervistato” ChatGPT, un software basato sul motore di OpenAI, specializzato nella conversazione con un utente umano. Ai lettori trovare le differenze

L’Intelligenza artificiale (AI) è ormai tra noi, anche se non ce ne accorgiamo. Abbiamo a che fare con contenuti originati o mediati da un motore di Intelligenza artificiale ogni giorno. Basti pensare ai programmi di intrattenimento trasmessi in televisione che sempre più spesso fanno uso dei cosiddetti “deep fake” in grado di simulare, in modo sempre più convincente, voce e volto di personaggi noti. Anche gli sviluppatori di software o compositori di brani musicali ormai affidano sempre più spesso alcuni aspetti routinari e preliminari del proprio lavoro a specifici motori AI in grado di produrre solide basi su cui impostare il successivo lavoro di affinamento. La stessa cosa avviene con contenuti grafici che vengono elaborati o addirittura prodotti da o insieme a strumenti di AI. Del resto, l’esperienza dell’uso di filtri, gadget, realtà aumentata è ormai a disposizione di tutti nell’uso quotidiano di smartphone o pc, ma c’è un aspetto che sta letteralmente dilagando nel dibattito in rete: la produzione di contenuti per blog e siti Internet da parte dell’Intelligenza artificiale. Davvero stiamo già leggendo articoli non scritti da un essere umano? Quali conseguenze può avere tutto ciò nel dibattito pubblico e quali sono i rischi per la società? Siamo andati alla fonte, intervistando direttamente ChatGPT, un software basato sul motore di AI di OpenAI, lanciato a fine novembre 2022 e specializzato nella conversazione con un utente umano.

Notare bene: tutti i testi generati da ChatGPT in questa “intervista” non sono stati in alcun modo editati o corretti.

Parliamo dei blog che utilizzano l’Intelligenza artificiale per la creazione di contenuti.

I blog che utilizzano l’Intelligenza artificiale per la creazione di contenuti sono un fenomeno relativamente nuovo, ma già in espansione. In questo tipo di blog, l’Intelligenza artificiale viene utilizzata per generare articoli o post che hanno come argomento una specifica tematica. L’utilizzo dell’Intelligenza artificiale per la creazione di contenuti ha alcuni vantaggi. Innanzitutto, permette di generare una quantità molto elevata di contenuti in poco tempo, il che può essere utile per chi gestisce un blog che richiede una frequenza di pubblicazione elevata. Inoltre, l’Intelligenza artificiale può essere utilizzata per creare contenuti di alta qualità, in quanto è in grado di analizzare una grande quantità di dati e di selezionare le informazioni più rilevanti per il tema trattato. Tuttavia, ci sono anche alcuni svantaggi nell’utilizzo dell’Intelligenza artificiale per la creazione di contenuti. Innanzitutto, è importante sottolineare che gli articoli generati dall’Intelligenza artificiale non hanno la stessa qualità di quelli scritti da un essere umano, in quanto mancano della creatività e della personalità che solo un essere umano può mettere in un testo. Inoltre, l’utilizzo dell’Intelligenza artificiale per la creazione di contenuti può avere un impatto negativo sulla qualità del lavoro dei giornalisti e degli scrittori, poiché potrebbe ridurre la domanda di contenuti scritti da esseri umani. In ogni caso, è importante sottolineare che l’Intelligenza artificiale può essere uno strumento utile per la creazione di contenuti, ma non può sostituire completamente il lavoro degli esseri umani.

È possibile utilizzare l’Intelligenza artificiale per generare anche immagini o contenuti artistici?

L’Intelligenza artificiale può essere utilizzata per creare immagini e opere d’arte in diversi modi. Ad esempio, ci sono programmi di Intelligenza artificiale che possono generare immagini o opere d’arte in base a un certo insieme di parametri o di regole predefinite. Altri programmi possono essere addestrati utilizzando un gran numero di esempi di immagini o opere d’arte, in modo da poter creare nuove immagini o opere d’arte che presentino caratteristiche simili a quelle degli esempi utilizzati per l’addestramento. Inoltre, l’Intelligenza artificiale può essere utilizzata per analizzare e interpretare opere d’arte esistenti, offrendo nuove prospettive o interpretazioni. Tuttavia, è importante notare che l’Intelligenza artificiale non può sostituire la creatività umana e il talento artistico. Le opere d’arte generate da programmi di Intelligenza artificiale possono essere interessanti o sorprendenti, ma difficilmente possono raggiungere la profondità e la complessità delle opere create dall’uomo. L’Intelligenza artificiale può essere uno strumento utile per gli artisti, ma non può sostituire la loro creatività e il loro talento.

Quali sono i rischi nell’utilizzare in modo acritico l’Intelligenza artificiale nella generazione di contenuti?

Ci sono alcune considerazioni da tenere in mente quando si utilizza l’Intelligenza artificiale per scrivere contenuti per il web. Ad esempio, è importante assicurarsi che il contenuto generato dall’Intelligenza artificiale sia coerente e comprensibile per gli utenti, in modo da poter essere facilmente compreso e utilizzato. Inoltre, è importante fare in modo che il contenuto generato dall’Intelligenza artificiale sia originale e non copiato da altre fonti, per evitare problemi di plagio o di violazione dei diritti d’autore. Inoltre, è importante notare che l’utilizzo di Intelligenza artificiale per generare contenuti può avere implicazioni etiche e legali da considerare. Ad esempio, potrebbe esserci il rischio che il contenuto generato dall’Intelligenza artificiale venga utilizzato in modo fraudolento o ingannevole. È importante essere consapevoli di queste questioni e adottare misure per minimizzare i rischi associati all’utilizzo dell’Intelligenza artificiale per la creazione di contenuti.

L’Intelligenza artificiale (AI) è ormai tra noi, anche se non ce ne accorgiamo. Abbiamo a che fare con contenuti originati o mediati da un motore di Intelligenza artificiale ogni giorno. Basti pensare ai programmi di intrattenimento trasmessi in televisione che sempre più spesso fanno uso dei cosiddetti “deep fake” in grado di simulare, in modo sempre più convincente, voce e volto di personaggi noti

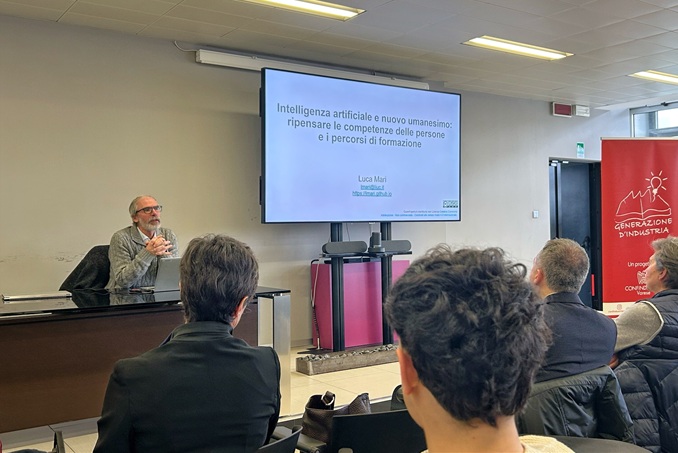

Da qui in avanti riprendiamo noi la penna in mano. Gli addetti ai lavori si interrogano su quanto davvero i testi generati dalle chatbot siano riconoscibili rispetto a quelli scritti da esseri umani. Copywriter, grafici e giornalisti digitali saranno sostituibili da un “grande fratello” in grado di produrre infiniti contenuti su qualsiasi argomento? Gli esperti, tuttavia, tendono a rassicurare. Siamo infatti ancora lontani dal disporre di motori AI in grado di generare contenuti totalmente affidabili, veritieri e soprattutto non distinguibili dalla produzione umana. Resta da chiedersi per quanto tempo ancora. Un celebre motore di ricerca ha acquisito infatti le necessarie licenze e pare che inizierà a rispondere agli utenti non più solo con un elenco di siti dove trovare l’informazione richiesta, ma anche con delle risposte puntuali che possono evitarci di aprire altre pagine (attualmente funestate da pubblicità, dark pattern, privacy & cookies banner). In questo scenario rischiano di essere messe in difficoltà intere filiere economiche legate al digital marketing, ma soprattutto a subire un ennesimo attacco potrebbe essere il pluralismo dell’informazione. Diventa perciò cruciale che l’algoritmo che governa l’apprendimento di questi motori d’Intelligenza artificiale sia per quanto possibile trasparente ed etico. “Le decisioni, anche le più importanti come quelle in ambito medico, economico o sociale, sono oggi il frutto di volere umano e di una serie di contributi algoritmici”. “La vita umana”, quindi, “viene a trovarsi al punto di convergenza tra l’apporto propriamente umano e il calcolo automatico, cosicché risulta sempre più complesso comprenderne l’oggetto, prevederne gli effetti, definirne le responsabilità”. Sono le parole di monsignor Vincenzo Paglia, Presidente della Pontificia Accademia per la Vita a testimoniare come, con la diffusione dell’uso dell’Intelligenza artificiale, stiano diventando sempre più di drammatica attualità temi affrontati in precedenza solo come lontani ipotetici scenari. A margine di tutto ciò, nasce GPTZero, il sito Internet in grado di analizzare un testo e comunicarci il suo livello di “perplessità” sul fatto che sia stato generato da ChatGPT. È stato creato soprattutto a supporto degli insegnanti, potenziali “vittime” di elaborati sintetici spacciati per autografi. Lo abbiamo provato con la nostra intervista e possiamo garantire che funziona. La guerra delle parole è appena iniziata.